Summit 시즌이 한창입니다! AWS Summit에 가본 적이 없다면 근처에 있는 AWS Summit을 확인해 보세요. 강연에 참석하고, 흥미로운 데모 및 활동을 시청하고, AWS 및 업계 종사자와 교류하는 등 다양한 활동을 할 수 있는 대규모 종일 이벤트가 열립니다. 무엇보다도 무료이므로 등록만 하면 됩니다! AWS 이벤트 페이지에서 해당 목록을 ...

기술 블로그 모음

국내 IT 기업들의 기술 블로그 글을 한 곳에서 모아보세요

![[고객사례] 브로넥스 "스마트 팩토리 산업을 함께 성장시켜 나가는 실질적인 동반자입니다."](https://blogthumb.pstatic.net/MjAyNTA0MjhfNDIg/MDAxNzQ1ODA0MTAyMjIz.CdeDM4ooaCQZZvj6RuzueEsPx84cL34zAb-vAUCpsTUg.EZhS8xYyBoQvd7qYIUzE-sj8gts_ukN_2I0DvFcpweIg.PNG/%BA%EA%B7%CE%B3%D8%BD%BA_thumb.png?type=s3)

안녕하세요, 누구나 쉽게 시작하는 클라우드 네이버클라우드 ncloud.com입니다. ✨ 네이버클라우드 스마트팩토리 가이드북 시리즈 ✨ 오늘 소개할 고객사는 150개 이상의 스마트 팩토리를 구축하며 제조업의 DX를 이끌고 있는 브로넥스입니다. 브로넥스는 국내 제조 환경에 가장 적합한 파트너를 찾는 도중 네이버 클라우드 플랫폼을 만나게 되었다고 하는데요....

안녕하세요. 커뮤니케이션 앱 LINE의 모바일 클라이언트를 개발하고 있는 Ishikawa입니다.저희 회사는 높은 개발 생산성을 유지하기 위해 코드 품질 및 개발 문화 개선에 힘쓰고...

NGINX gzip 모듈을 이용하여 정적 파일 응답 속도 개선 이 블로그 포스트는 NGINX gzip 모듈을 활용하여 웹 서버의 응답 속도와 전송 데이터의 효율성을 개선하는 방법을 다룹니다. 먼저 NGINX gzip 모듈의 주요 설정 옵션과 기능을 설명하고, 실제 NGINX 서버에 정적 파일을 배포하여 gzip 적용 전후의 성능 차이를 비교합...

토스 디자인 컨퍼런스 SImplicity가 돌아왔어요.

![[안내] HyperCLOVA X SEED 공개 기념 추가 혜택 안내 (~5/15)](https://blogthumb.pstatic.net/MjAyNTA0MjNfMjcg/MDAxNzQ1MzkyMDIwMjI0.ec2H2NiiMbLWtwTGNF8W9Ul5SP4jtPn8D5HmuWYr2gog.8AQZaY5O-Km6x46AyimW8D51iexgULpigRr5rjJ2GREg.PNG/image.png?type=s3)

안녕하세요, 누구나 쉽게 시작하는 클라우드 네이버클라우드 ncloud.com입니다. 바로 오늘! 국내 소버린 AI 생태계 구축을 위한 상업용 오픈소스 AI, HyperCLOVA X SEED를 공개하였습니다. 작지만 강력한 HyperCLOVA X SEED는 기업이나 개발자가 특정 비즈니스의 요구사항에 맞게 튜닝하여 다양한 산업 분야에 맞춤형으로 적용할 ...

![[캘린더️] 5월 무료 교육 웨비나 일정 모음](https://blogthumb.pstatic.net/MjAyNTA0MjJfMTA4/MDAxNzQ1MzEwNzczMDk3.ut5P21eEVg-6_PVkJmkjhtLKH58bJaaPJzRX_cch0Ekg.w5ulN38W5Jd9kRdqvm0sfGm5U74etcpfh7vqYljpnlIg.PNG/2505_edu_thumb.png?type=s3)

안녕하세요, 누구나 쉽게 시작하는 클라우드 네이버클라우드 ncloud.com 입니다.

2018년에 AWS Graviton 프로세서가 출시된 이후, AWS는 지속적인 혁신으로 고객의 클라우드 워크로드 성능을 향상해 왔습니다. Graviton3 기반 인스턴스의 성공에 이어 NVMe 기반 SSD 로컬 스토리지를 갖춘 세 가지 새로운 AWS Graviton4 프로세서 기반 Amazon Elastic Compute Cloud(Amazon EC2...

![[행사후기] 스마트팩토리 수요-공급기업, 당장 만나 매칭데이 (4/14 @시흥)](https://blogthumb.pstatic.net/MjAyNTA0MTVfMjEw/MDAxNzQ0Njk4NzQyNjc1.cw0lsXfqmkr5oT1X5sc3JDULniUdLx2b4J6bbQ1XvW0g.HkilcUXXT6Uy3gKJw2n1LpwYNEFjvVPj2WUh_zw3SQEg.PNG/%B8%C5%C4%AA%B5%A5%C0%CC_thumb.png?type=s3)

안녕하세요, 누구나 쉽게 시작하는 클라우드 네이버클라우드 ncloud.com입니다. ✨ 네이버클라우드 스마트팩토리 가이드북 시리즈 ✨ 찾기 힘들었던 수요기업과 공급기업, 우리 지금 만나! 4월 14일 금요일, 시흥산업진흥원에서 스마트팩토리 수요-공급기업 매칭데이가 열렸습니다! 지난 3월에 모집했던 지원사업의 프로그램 중 하나였던 이번 행사는 솔루션사(...

쿠폰, 어디에 쓸 수 있어요? — 이벤트 기반 적용 상품 조회 시스템 구축안녕하세요, 29CM Commerce Core Engineering 에서 Sale Pricing 팀으로 일하고 있는 백엔드 개발자 조한석이라고 합니다.저는 주로 쿠폰, 결제혜택 등 할인과 가격 도메인을 개발하고 있는데요, 쿠폰 시스템을 개발하고 관리하면서 사용자들로부터 가장 많이...

![[국제발신] CJ : 추가 비용으로 인해 배송이 중단되었습니다. httpx://p**.is/7ek***을 방문해 주세요.](https://blog.kakaocdn.net/dn/r6muw/btsNqFfGKyk/k0vtpy025lGtkekYaVvfAK/img.png)

[4월 셋째주] 알약 스미싱 알림 본 포스트는 알약M 사용자 분들이 '신고하기' 기능을 통해 알약으로 신고해 주신 스미싱 내역 중 '특이 문자'를 자체&nbs...

안녕하세요. 커뮤니케이션 앱 LINE의 모바일 클라이언트를 개발하고 있는 Ishikawa입니다.저희 회사는 높은 개발 생산성을 유지하기 위해 코드 품질 및 개발 문화 개선에 힘쓰고...

NGINX Troubleshoot (NGINX CA, F5N4) 학습 가이드 이 포스트에서는 NGINX 프로세스 제어 방법부터 기본적인 NGINX Troubleshoot, 그리고 TLS 보안 설정까지 다양한 NGINX 관련 문제를 해결하는 방법을 살펴보겠습니다. 웹 서버와 리버스 프록시로 널리 사용되는 NGINX는 높은 성능과 안정성으로 유명합니다. ...

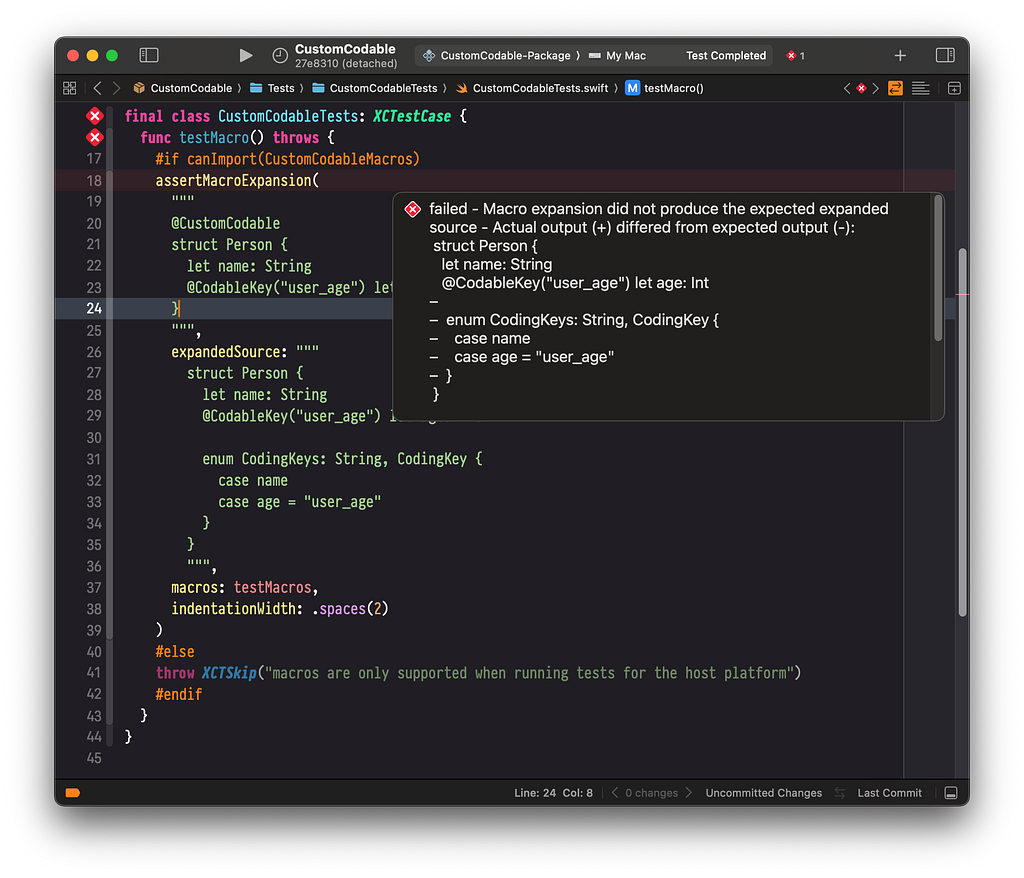

안녕하세요. 모바일실 iOS팀에서 iOS Engineer로 일하고 있는 Elon이에요.제가 속한 모바일실은 당근에 전사적으로 필요한 기능을 개발해요. CI/CD, 애널리틱스, 실험 플랫폼, 딥링크 시스템 등을 직접 개발 및 관리하며, 앱 개발에 필요한 플랫폼 엔지니어링을 담당하고 있어요. 이러한 플랫폼 엔지니어링에는 iOS 엔지니어분들의 개발 생산성을...

NGINX Configuration: Demonstrate (NGINX CA, F5N3) 학습 가이드 NGINX는 고성능 웹 서버이자 리버스 프록시로, 현대 웹 인프라에서 핵심적인 역할을 담당하고 있습니다. 해당 포스트에서는 NGINX Configuration 을 통해 연결 관리부터 SSL 보안 설정까지 심도 있게 살펴보고, 실무에서 바로 적용할 수 ...

NGINX Configuration: Knowledge (NGINX CA, F5N2) 학습 가이드 NGINX Configuration 을 다양한 역할로 구성하는 방법에 대해 정리합니다. 이 글에서는 Load Balancer, 캐시 서버, 웹 서버, 리버스 프록시 구성까지 모두 다룰 예정이며, 실무에서도 바로 적용 가능한 개념과 설정을 중심으로 설명합니...

이번 주 파리 서밋을 시작으로 AWS Sumit 2025 시즌이 시작되었습니다. 이는 전 세계 클라우드 컴퓨팅 커뮤니티가 한 자리에 모여 학습과 협업에 힘쓰는 무료 이벤트입니다. 4월 11일에 개최된 AWS Community Day 루마니아에서는 현지 커뮤니티가 함께 성장하고 포용하기 위해 어떻게 기회를 창출하고 있는지 알 수 있었습니다. 지난주 출시...

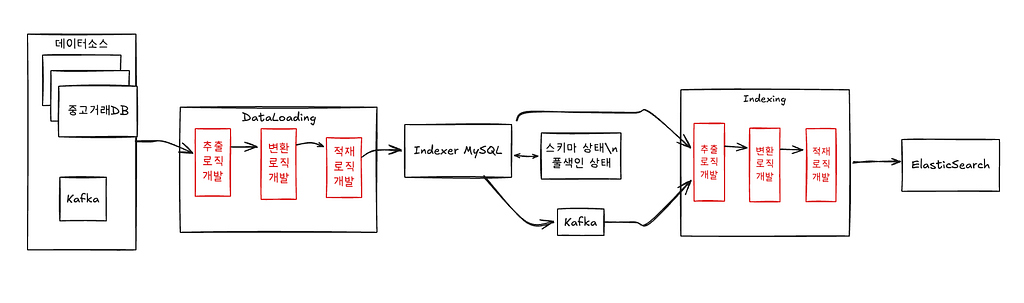

안녕하세요! 검색플랫폼팀의 Backend Engineer 하이(Hy)에요.당근에는 중고거래, 동네생활, 동네업체, 채팅 등 다양한 서비스가 있는데요. 검색플랫폼팀은 검색 서비스를 안정적으로 지원하는 플랫폼을 만들며, 다양한 서비스의 검색을 지원하고 있어요. 이를 위해서는 가장 먼저 각 서비스들의 데이터가 필요한데요. 이번 글에서는 각 서비스의 데이터를...

NGINX Management (NGINX CA, F5N1) 학습 가이드 이번 포스트에서는 NGINX Management 영역(F5N1)에 해당하는 필수 주제를 체계적으로 살펴보고 실무 환경에서의 활용법을 깊이 있게 이해합니다. NGINX는 단순한 웹 서버를 넘어 Reverse Proxy, Load Balancer, API Gateway 등 다양한 시...

![[행사스케치] 의료 환경과 기술의 접점, 대한병원정보협회 2025 춘계학술세미나](https://blogthumb.pstatic.net/MjAyNTA0MTRfMjc3/MDAxNzQ0NjA5MTEzMDE2.ZSWFPKXDwyc_jn0hDwLLItAVl-_xI92kqxfzD2EsCNIg.gKDu8M0kCuyfI4ShD85vdL-n0tfI7C_0bsfh_6fQd-8g.PNG/250414_%BA%B4%BF%F8%C1%A4%BA%B8%C7%F9%C8%B8%BC%BC%B9%CC%B3%AA.png?type=s3)

안녕하세요, 누구나 쉽게 시작하는 클라우드 네이버클라우드 ncloud.com입니다. 지난 4.10-4.11, 서울아산병원에서 2025년도 대한병원정보협회 춘계학술세미나가 개최되었습니다. 이틀에 걸쳐 진행된 이번 세미나는 1일차: 데이터분과 세미나 "의료 기관의 데이터 전략: 데이터보안 vs 상호운용성" 2일차: 의료IT분과 세미나 "불확실한 시대에 기...

주니어 개발자의 성장을 목표로 진행한 에러 디버깅 스터디 과정을 소개합니다.

AWS re:Invent 2023에서 가장 자주 액세스하는 데이터와 지연 시간에 민감한 애플리케이션을 위해 10밀리초 미만의 일관된 데이터 액세스를 제공하도록 특별히 제작된 고성능 단일 가용 영역(AZ) 스토리지 클래스인 Amazon S3 Express One Zone을 소개했습니다. S3 Express One Zone은 S3 Standard보다 최대...

.png)

사장님들을 더 깊게 이해하고 싶어, 직접 사장님이 되어봤습니다. 사업자 등록부터 판매까지 여정을 통해 배운 점들을 들려드릴게요.

의존성 그래프를 활용한 프로젝트 시각화 — 사이드 이펙트 한눈에 파악하기안녕하세요! 당근의 동네 지도 탭에서 확인할 수 있는 동네 가게 화면과 동네 사장님들이 가게를 관리하기 위한 비즈니스 도구를 만드는 로컬 비즈니스의 Frontend Engineer 준(Joon)이에요.혹시 ‘줄줄이 고구마’라는 말을 들어보신 적 있으신가요? 고구마 하나를 캐니, 그...

Amazon Q Developer는 통합 개발 환경(IDE)에서 AI를 기반한 코드 작성, 문서화, 리팩터링부터 유닛 테스트 구현에 이르기까지 다양한 태스크를 최소한의 입력으로 수행할 수 있습니다. 오늘 부터 한국어를 비롯한 다국어를 지원하기 시작했습니다. 이제 한국어로 좀 더 편리하게 AI 코딩 도우미를 활용해 보실 수 있습니다. 한국어 지원은 인라...

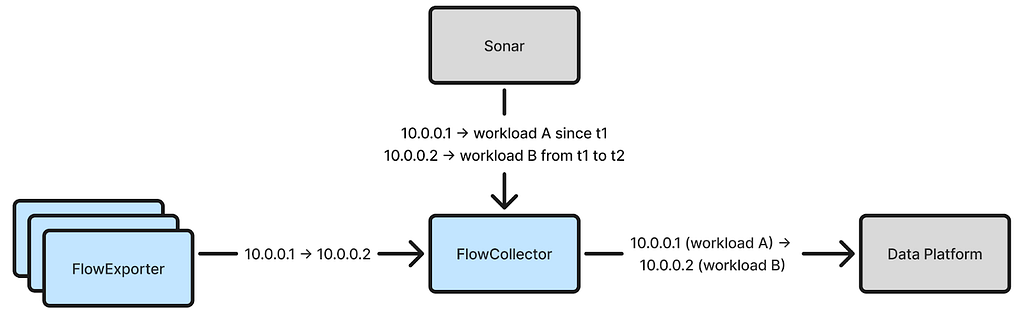

By Cheng Xie, Bryan Shultz, and Christine XuIn a previous blog post, we described how Netflix uses eBPF to capture TCP flow logs at scale for enhanced network insights. In this post, we delve deepe...

![[고객사례] 롯데카드, "클라우드 컨택센터 솔루션 도입으로 운영 효율성을 크게 개선했습니다."](https://blogthumb.pstatic.net/MjAyNTA0MDhfMjY2/MDAxNzQ0MDc4MDc2OTQ5.N8MfcrPeP14bl9mvscdwvSFw1a_vYjxyUJUQnpDQYQEg.PK1_x3zpMjWCChB10FgsAuMgQfw_Wr6G2COtqxB_OBkg.PNG/%B7%D4%B5%A5%C4%AB%B5%E5%BD%E6%B3%D7%C0%CF.001.png?type=s3)

안녕하세요, 누구나 쉽게 시작하는 클라우드 네이버클라우드 ncloud.com 입니다. 롯데카드는 국내 최대의 유통, 서비스 네트워크를 기반으로 하는 신용카드사입니다. 롯데카드 홈페이지 바로가기 다양한 라이프스타일을 고려한 업종별 제휴 카드와 특화 카드로 경쟁력 있는 서비스를 제공 중인데요. 그런 롯데카드가 최근 국내 카드사 중 최초로! 클라우드 기반의...

지난 AWS re:Invent 2024에서 AWS는 차세대 파운데이션 모델(FM)인 Amazon Nova 모델을 발표했습니다. 여기에는 텍스트 설명과 선택적 참조 이미지(통칭하여 ‘프롬프트’)로 짧은 동영상을 생성하는 동영상 생성 모델인 Amazon Nova Reel이 포함됩니다. 오늘은 Amazon Nova Reel 1.0과 비교하여 6초 싱글샷 동...

국방 디지털 전환, 군사보안, 전투 클라우드와 AI 결합. 세미나 현장에서 나온 핵심 질문에 전문가들이 답변합니다.

군사 기술, 디지털 기술의 발전으로 전쟁 수행 방식이 비약적인 변화를 맞이하고 있습니다. 디지털 전장 변화의 동향과 삼성SDS가 준비하는 기술적 기반을 알아봅니다.